Descubre cómo Google Search Console informa errores de “noindex detected” en el encabezado X-Robots-Tag, y qué posibles causas y soluciones han sugerido expertos como John Mueller para resolver este problema técnico en SEO.

Error “noindex detected” en Search Console explicado

Según la fuente, algunos usuarios han reportado que Google Search Console muestra un error de “noindex detected en X-Robots-Tag HTTP header” en páginas que, en apariencia, no tienen dicho encabezado. Este error ha confundido a muchos webmasters.

La situación descrita en un hilo de Reddit revela que la consola informa que la página está bloqueada para indexar, a pesar de no existir ningún meta elemento noindex ni restricciones en el archivo robots.txt.

A pesar de haber verificado el HTML y las configuraciones del servidor, el problema persiste, lo que ha llevado a la comunidad a buscar explicaciones y soluciones alternativas para este enigmático error.

Posibles causas: interferencia de CDNs y datos desactualizados

Según informes, uno de los factores que pueden estar causando el error es la interferencia de CDNs, como Cloudflare, que podrían modificar las respuestas del servidor y añadir encabezados indeseados.

Un Redditor sugirió comparar la prueba en vivo de Google Search Console con la versión rastreada para determinar si Google está recibiendo una respuesta desactualizada o modificada.

Además, se menciona que URLs antiguas, indexadas hace mucho tiempo, pueden seguir generando conflictos y dar la impresión de que hay un error en el encabezado, aunque el contenido actual sea indexable.

Diagnóstico y pasos recomendados para solucionar el error

La comunidad de Reddit ha compartido pasos detallados para diagnosticar el problema. En primer lugar, se recomienda comparar la Live Test de Search Console con la página rastreada para identificar discrepancias.

Es importante inspeccionar las Transform Rules, los encabezados de respuesta y cualquier Worker de Cloudflare que pueda estar modificando la respuesta del servidor.

Asimismo, se aconseja utilizar la herramienta Rich Results Tester de Google, que simula el comportamiento de Googlebot, para ver exactamente qué contenido está recibiendo Google.

Para sitios con WordPress, deshabilitar temporalmente los plugins SEO también puede ayudar a descartar que sean estos los responsables de la aparición del error.

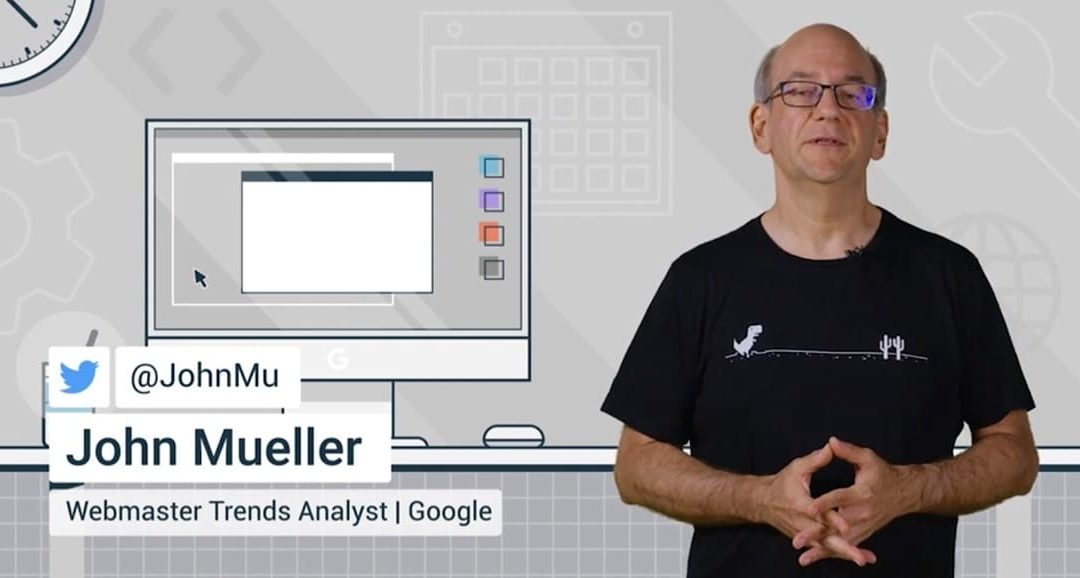

La experiencia de John Mueller en el diagnóstico del error

En la discusión de Reddit, John Mueller ofreció su perspectiva y se mostró dispuesto a revisar ejemplos concretos de URLs afectadas. Su experiencia sugiere que el error podría estar relacionado con CDNs o incluso con rastreos antiguos.

Mueller explicó que ha visto este error en contextos relacionados con redes de distribución de contenido y con URLs que han estado indexadas desde hace mucho tiempo, lo que podría generar inconsistencias.

Según sus comentarios, este problema no es inusual y se puede solucionar revisando las configuraciones de caché y transformaciones de respuesta, elementos que a menudo se pasan por alto.

Soluciones adicionales: respuestas 401 y autenticación

Un usuario compartió que un error 401 – «no autorizado» – también puede generar mensajes de bloqueo de indexación en Search Console. Esto ocurre cuando la página requiere autenticación y no se proporcionan las credenciales correctas.

La solución en ese caso fue incluir una notación en el archivo robots.txt para bloquear el rastreo de páginas de inicio de sesión, evitando que Google intente indexarlas.

Este enfoque muestra la importancia de revisar no solo la configuración del servidor, sino también las políticas de acceso que pueden afectar la indexación de contenido.

Uso de herramientas y buenas prácticas en SEO técnico

Para diagnosticar este tipo de errores, se recomienda hacer uso de herramientas como curl con el user-agent de Googlebot y la cabecera «Cache-Control: no-cache», lo cual ayuda a obtener la respuesta real del servidor.

Registrar las solicitudes del servidor para Googlebot es otra estrategia sugerida para detectar la aparición inesperada de encabezados X-Robots-Tag. Esto permite tener un control detallado del tráfico y las respuestas.

Implementar estas buenas prácticas ayuda a mejorar la comprensión de cómo Google indexa el contenido y a prevenir futuros problemas de indexación que puedan afectar el posicionamiento SEO.

Impacto del error en la estrategia SEO y recomendaciones finales

Según la fuente, este error puede tener un impacto negativo en la estrategia SEO de un sitio, ya que impide que Google indexe correctamente las páginas, afectando la visibilidad en los resultados de búsqueda.

Es crucial que los webmasters verifiquen regularmente la configuración de su CDN, revisen las transformaciones de respuesta y se aseguren de que no existan errores de autenticación que bloqueen el acceso de Googlebot.

Además, se recomienda utilizar el Rich Results Tester para confirmar qué ve realmente Google, y así ajustar las configuraciones en consecuencia.

Conclusión: Comprender y solucionar el error “noindex detected”

En resumen, según informes y la intervención de John Mueller, el error de “noindex detected en X-Robots-Tag” puede deberse a interferencias de CDNs, respuestas desactualizadas o problemas de autenticación.

Implementar una revisión detallada de las reglas de transformación, revisar el comportamiento del servidor mediante herramientas de diagnóstico y utilizar el Rich Results Tester son pasos fundamentales para solucionar el problema.

Si deseas profundizar en estos temas, visita la documentación oficial de Google y mantente al tanto de las últimas actualizaciones en SEO técnico para garantizar que tus páginas se indexen correctamente.

Fuente: https://www.searchenginejournal.com/google-on-search-console-noindex-detected-errors/540829