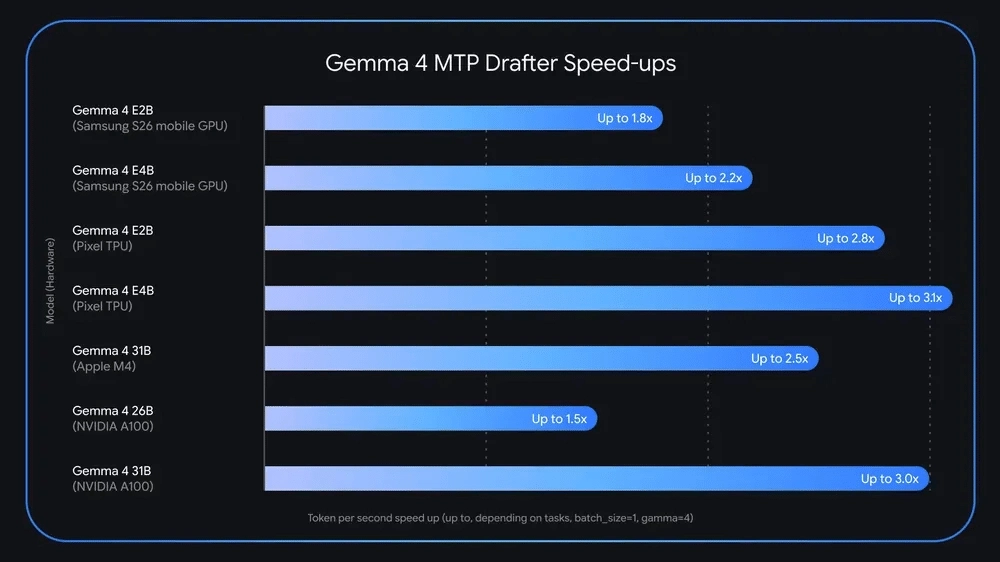

Google sigue empujando el rendimiento de sus modelos de inteligencia artificial y ahora ha presentado nuevas mejoras para Gemma 4, su familia de modelos abiertos basada en la tecnología de Gemini. Según la información difundida por la compañía y recogida por distintos medios especializados, la firma ha conseguido acelerar hasta tres veces la generación de respuestas gracias a una combinación de speculative decoding y modelos auxiliares conocidos como drafters. El movimiento llega en un momento en el que la velocidad de inferencia se ha convertido en uno de los grandes retos de la IA generativa.

De acuerdo con los datos facilitados por Google, estas optimizaciones buscan reducir la latencia y mejorar la experiencia de uso en tareas complejas. La compañía pone el foco en hacer más eficientes los modelos abiertos, especialmente para desarrolladores y empresas que necesitan ejecutar inteligencia artificial en infraestructuras con recursos limitados. El anuncio también refuerza la estrategia de Google en el terreno open source, donde Gemma se ha convertido en una de sus principales apuestas frente a modelos de Meta, Microsoft o Alibaba.

Qué es speculative decoding y por qué acelera los modelos

Según la explicación técnica difundida por la fuente, el speculative decoding permite que un modelo pequeño genere una predicción preliminar de varios tokens antes de que el modelo principal valide el resultado. Esto evita parte del trabajo repetitivo habitual en la generación de texto y consigue reducir tiempos de respuesta sin necesidad de cambiar la arquitectura principal del modelo.

La técnica no es completamente nueva en la industria. Investigaciones académicas previas ya habían mostrado mejoras importantes usando speculative sampling y modelos draft más ligeros. Sin embargo, Google ahora la adapta específicamente a Gemma 4 y asegura que el salto de rendimiento puede llegar a triplicar la velocidad en determinados escenarios de inferencia.

Según los datos compartidos, el sistema funciona utilizando pequeños modelos auxiliares llamados drafters. Estos modelos generan predicciones rápidas y posteriormente el modelo principal verifica si las respuestas son válidas. El objetivo es mantener la calidad de salida mientras se reducen tiempos de procesamiento y consumo computacional.

La clave del sistema está en adelantar posibles respuestas para que el modelo principal tenga menos carga de trabajo durante la generación de texto, según la información técnica difundida por Google.

Gemma 4 busca competir en eficiencia y rendimiento

Gemma nació como la propuesta abierta de Google basada en parte de la investigación detrás de Gemini. Desde su lanzamiento, la familia de modelos ha intentado posicionarse como alternativa eficiente para desarrolladores que buscan ejecutar IA avanzada sin depender únicamente de infraestructuras gigantescas.

De acuerdo con la compañía, la nueva optimización puede ser especialmente útil en aplicaciones donde la latencia es crítica. Entre ellas aparecen asistentes conversacionales, herramientas de productividad, generación de código o sistemas de automatización empresarial. Reducir unos segundos en la generación de respuestas puede marcar diferencias importantes en plataformas con millones de usuarios.

La mejora también encaja con una tendencia cada vez más visible en la industria: la carrera por hacer los modelos más rápidos y baratos. En los últimos meses, empresas como OpenAI, Anthropic, Microsoft o Meta han intensificado el trabajo en optimización de inferencia para reducir costes y ampliar el acceso a modelos avanzados.

- Menor latencia en generación de texto.

- Menor consumo computacional durante la inferencia.

- Más eficiencia en hardware limitado.

- Posible reducción de costes para empresas y desarrolladores.

El papel de los drafters dentro de la arquitectura

Según la información publicada, los nuevos drafters funcionan como modelos secundarios especializados en anticipar respuestas rápidas. Estos modelos son mucho más ligeros que Gemma 4 completo, por lo que pueden generar múltiples posibilidades en menos tiempo.

El modelo principal actúa después como supervisor. Valida las propuestas generadas y descarta las que no cumplen los criterios adecuados. Según la fuente, el sistema busca equilibrar velocidad y precisión, evitando pérdidas significativas de calidad durante la generación de contenido.

La estrategia recuerda a otros enfoques híbridos que la industria está utilizando para optimizar LLMs. En lugar de depender exclusivamente de modelos gigantes, las empresas empiezan a combinar modelos grandes y pequeños para repartir tareas y reducir el gasto computacional.

De acuerdo con los datos compartidos, esta técnica podría ser especialmente útil en entornos edge o dispositivos con menos capacidad. El interés por ejecutar IA localmente está creciendo entre desarrolladores y fabricantes de hardware, especialmente tras el auge de PCs y smartphones preparados para IA generativa.

La presión competitiva en el mercado de la IA abierta

El movimiento de Google llega en plena competencia por dominar el ecosistema open source de inteligencia artificial. Modelos como Llama, Qwen o Phi han aumentado la presión sobre las grandes tecnológicas. La eficiencia ya no es un detalle secundario, sino uno de los principales factores de adopción.

Según analistas del sector, las empresas necesitan modelos capaces de ofrecer buen rendimiento sin disparar los costes de infraestructura. La velocidad de inferencia influye directamente en el gasto operativo, especialmente en aplicaciones con tráfico elevado o generación continua de contenido.

Google también parece querer reforzar la imagen de Gemma como plataforma flexible para investigación y desarrollo. La compañía ya había presentado anteriormente diferentes tamaños de modelos y variantes adaptadas a múltiples casos de uso. Ahora el foco pasa claramente por la optimización práctica y no solo por aumentar parámetros.

Además, el anuncio se produce mientras la industria avanza hacia agentes de IA más autónomos y sistemas multimodales. En ese contexto, la rapidez de respuesta será todavía más importante, especialmente en flujos de trabajo automatizados o tareas en tiempo real.

Qué impacto puede tener esta mejora para desarrolladores y empresas

Para muchos desarrolladores, uno de los mayores problemas actuales es el coste de ejecutar modelos avanzados a gran escala. Según la información difundida por Google, las mejoras de Gemma 4 podrían facilitar despliegues más económicos y eficientes en servidores menos potentes.

Esto podría beneficiar especialmente a startups y pequeñas empresas interesadas en integrar IA generativa sin depender exclusivamente de grandes proveedores cloud. Reducir el consumo de GPU sigue siendo una prioridad en un mercado donde la demanda de hardware para IA continúa disparada.

La optimización también podría acelerar la adopción de modelos abiertos en proyectos comerciales. Según la fuente, Google quiere facilitar un ecosistema más accesible para investigadores, programadores y empresas que desarrollan soluciones basadas en IA generativa.

Por ahora, la compañía no ha detallado todos los escenarios exactos donde se consigue el máximo rendimiento anunciado. Aun así, el movimiento confirma que la próxima gran batalla de la inteligencia artificial no solo se librará en capacidad o tamaño de modelos, sino también en velocidad, eficiencia y costes operativos.

Fuente: https://ai.google.dev/gemma/docs/mtp/overview?hl=es-419