¿Te has encontrado alguna vez con una caída repentina en el crawling de Googlebot en tu sitio web? Según la información más reciente, la raíz del problema puede estar más allá de los simples errores 404. Descubre por qué los errores de servidor son el verdadero enemigo, cómo identificarlos y qué pasos debes seguir para recuperar el ritmo de rastreo de Google.

Googlebot deja de rastrear repentinamente: ¿qué está pasando realmente?

No es raro que los administradores web detecten una disminución drástica en las solicitudes de rastreo de Googlebot, pero una caída del 90% en tan solo 24 horas encendió todas las alarmas en un hilo de Reddit reciente. En ese caso, la implantación accidental de URLs hreflang rotas en las cabeceras HTTP fue el presunto desencadenante del problema, ya que todas respondían con errores 404.

El propietario del sitio explicaba: “Después del cambio, Googlebot rastreó esas URLs rotas, todas devolvieron errores 404. En tan solo un día, las solicitudes de rastreo cayeron casi por completo. Las páginas indexadas se mantienen estables, pero el volumen de crawling no se ha recuperado”.

Esta situación preocupa especialmente a quienes dependen del tráfico orgánico y buscan mantener una óptima visibilidad en los resultados de búsqueda de Google.

Pero, ¿son realmente los 404 los responsables de esta caída tan brusca? Aquí es donde aparece la visión de los expertos de Google.

Según Google, los verdaderos culpables son los errores del servidor

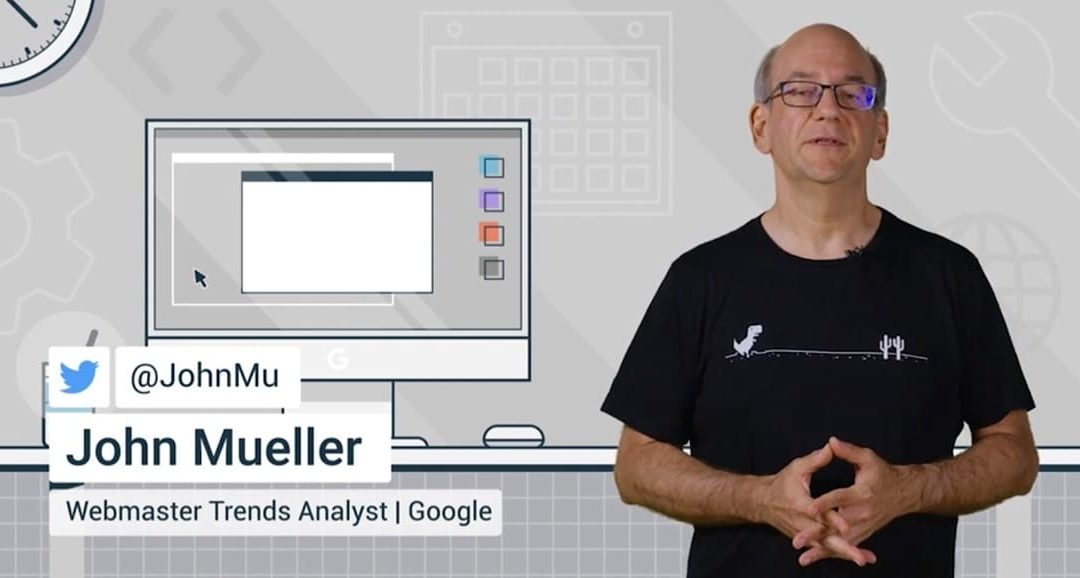

John Mueller, portavoz reconocido de Google, salió al paso tras leer el caso y matizó que “no esperaría que el ritmo de crawl se ajuste tan rápido solo por errores 404. Suele deberse a respuestas como 429, 500, 503 o timeouts”. Por tanto, Mueller recomienda revisar detenidamente lo que realmente ocurrió en el servidor durante ese periodo crítico.

“Si fue una CDN la que bloqueó a Googlebot, hay que asegurarse de solucionar eso también. Cuando todo vuelve a la normalidad en el servidor, la tasa de crawl se recupera automáticamente”, añade, recordando que este proceso no tiene un plazo fijo y puede tardar más de lo que muchos esperan.

Desde Google, insisten que los errores 404 no afectan al ritmo de rastreo de esa manera, ya que Googlebot los gestiona y volverá a intentar acceder a esas URLs más adelante.

En cambio, un aluvión de errores 429 (Too Many Requests), 500 (Internal Server Error) o 503 (Service Unavailable) puede llevar a que Google reduzca el crawling para proteger los recursos del sitio. Esto está recogido en la propia documentación oficial de Google para la gestión del crawl rate.

Cómo actuar si tu web sufre una caída del crawling

Frente a una abrupta reducción de las solicitudes de rastreo, la recomendación de los expertos es clara: revisa los registros de tu servidor. Es clave comprobar si, durante ese lapso, se multiplicaron los códigos 429, 500, 503 o los tiempos de espera.

Además, se aconseja validar que ningún firewall, CDN o limitador de tasa estuviera bloqueando el acceso de Googlebot. Muchos problemas imprevistos suelen estar relacionados con configuraciones temporales en proveedores externos o parámetros de seguridad mal ajustados.

No menos importante: comprueba en Google Search Console el informe de estadísticas de rastreo. Así podrás identificar picos inusuales o tendencias que te ayuden a diagnosticar la verdadera causa del problema y a actuar rápidamente.

Visita nuestra sección de SEO para saber más sobre cómo optimizar tu web y descubrir buenas prácticas para evitar errores técnicos que puedan perjudicar tu posicionamiento.

¿Cuánto tarda Google en recuperar el ritmo de rastreo?

Una vez solucionados los fallos del servidor, el crawl rate debería volver a la normalidad de forma automática, pero no existe una fecha concreta para la recuperación. Según Mueller, Googlebot incrementa el ritmo de rastreo gradualmente para evitar sobrecargar el servidor de nuevo.

Esto significa que la paciencia es fundamental tras corregir los problemas. Durante este proceso, mantener la estabilidad del servidor y vigilar las estadísticas de rastreo permitirá identificar rápidamente cualquier recaída.

¿Quieres profundizar aún más? Consulta la documentación oficial de Google sobre la limitación del crawling para conocer las mejores prácticas y pautas oficiales.

Conclusiones clave para administradores web y SEOs

- Los errores 404 no provocan caídas drásticas en el crawling de Googlebot; suelen ser los errores de servidor como 429, 500 o 503.

- Monitoriza los logs y la Search Console para detectar y corregir estos fallos cuanto antes.

- La recuperación del crawling lleva tiempo, pero se produce automáticamente cuando se soluciona la causa principal.

- No ignores las señales de tu proveedor de hosting o CDN; pueden estar detrás de los bloqueos más inesperados.

En definitiva, si quieres preservar la salud SEO de tu sitio web y garantizar una correcta visibilidad en Google, mantén a raya los errores del servidor y estate atento a cualquier descenso inusual del ritmo de rastreo. Una monitorización constante, junto a rápidas actuaciones, serán tus mejores aliados.

Fuente: https://www.searchenginejournal.com/googlebot-crawl-slump-mueller-points-to-server-errors/553715/